Itt van egy vitathatatlan tény: az elmúlt években több, mint asztali számítógépet értékesítettek a PC-k laptop piacán. Ez a mobil forradalom elkerülhetetlen mellékhatása, amelynek eredményeként manapság egy olyan világban élünk, amelyben a számítógép-felhasználók nem akarnak egy helyen „lehorgonyozni”. Ehelyett mozgásban akarják használni őket, bármikor, bárhol, ahogy tetszik..

A legtöbb modern modellnél ez nem jelent problémát - a modern laptop-konfigurációk villámsebességet biztosítanak olyan esetekben, mint például internetes szörfözés, irodai alkalmazásokkal való munka, filmek nézése és zenehallgatás..

A játékokkal azonban a helyzet kicsit más. Hagyományosan a számítógépes alkalmazások hardveres erőforrásai közül az egyik leginkább "kapzsi", és rendkívül magas követelményeket támasztanak a rendszer jellemzőivel szemben. És mivel a modern mobil technológiák továbbra is bizonyos szintű kompromisszumot igényelnek a teljesítmény és az energiahatékonyság között, még a legerősebb (és drágább) játékosztályú laptop sem tudja biztosítani a legújabb generációs alkatrészekkel felszerelt asztali számítógép teljesítményét..

De ez valószínűleg a múlté, az Adaptive Sync nevű nagyon érdekes technológiának köszönhetően. Ezért köszönetet kell mondanunk az NVIDIA-nak, amely - bár nem nevezhető alkotójának - a legnagyobb hozzájárulást nyújtott e technológia kereskedelméhez..

Segítségével a hamarosan futó laptopok képesek lesznek olyan játékélményt nyújtani, amely hasonló az asztali számítógépeikéhez hasonló minőségi tapasztalatokkal, az energiahatékonysággal kapcsolatos döntő kompromisszumok nélkül..

A keret szinkronizálása és miért ez a probléma a játékosok számára?

Ha olyan anyagokat olvas, amelyek egy adott konfiguráció játékteljesítményét tárgyalják, akkor valószínűleg észrevette, hogy a szerzők gyakran egy adott mutatóra hivatkoznak - 60 képkocka másodpercenként. A legtöbb játékos számára a dédelgetett 60 kép / mp egyfajta "Holy Grail" a jó minőségű számítógépes játéknak, ám ennek oka nem a számítógépes hardverhez kapcsolódik, hanem a modern LCD-kijelzők jellemzőihez..

Manapság a legtöbb kijelző, különösen a mobil számítógépekkel felszerelt kijelzők rögzített frissítési gyakoriságot használnak. Ez az egyes monitorok egyik fő mutatója, amely jelzi, hogy hányszor másodpercenként frissül a rajta megjelenített kép..

Egy másik olyan paraméter, amely már közvetlenül a videokártyára utal, „keretek másodpercenként” (képkocka másodpercenként vagy csak fps) néven ismert, és a neve önmagáért beszél: ez a játékkockák száma, amelyek a megfelelő konfigurációval biztosíthatók a mozgás reális illúziójának létrehozásához..

A maximális játékélmény elérése érdekében ennek a két mutatónak szinkronnak kell lennie - azaz A számítógépes berendezéseknek 60 képkockát kell biztosítaniuk másodpercenként, amelyet a monitor 60 Hz frissítési frekvenciával jelenít meg. Ebben az ideális esetben a képernyőn sima képet fog látni, nem villog, nem szakad el vagy elmosódik.

Sajnos a gyakorlatban ez soha nem fog megtörténni. Ennek oka az, hogy minden modern kijelző rögzített, 60 Hz-es frissítési frekvenciával működik (bár néhány monitornál a frekvencia 120-144 Hz). A másodpercenkénti képkockák száma azonban szükségszerűen változik, vagyis ez a mutató nem lehet állandó. Például egy nyílt világú játékban ugyanaz a rendszer képes 50+ képkocka előállítására beltérben (azaz a kívánt teljesítmény elérése az áhított 60 kép / mp-nél), de nyitott helyeken az indikátor gyorsan másodpercenként 30–40 képkockára süllyedhet. Gyenge konfigurációk esetén a távolság a gyakori képernyőfrissítések és a másodpercenkénti képkockák között még nagyobb lesz.

A problémát tovább bonyolítja az a tény, hogy a képkockák száma nagyban függ a grafikus beállítások és a játék felbontásának kiválasztott szintjétől. Tehát például egy bizonyos konfiguráció garantálhatja az 50–60 kép / mp sebességet és egy viszonylag kényelmes játékot, 1280 x 720 pixel felbontással és átlagos részletgazdagsággal. Érdemes azonban növelni a felbontást Full HD-re (1920 x 1080 pixel), a vizuális paramétereket pedig ultraszintre, és a teljesítmény 10-20 képkocka / másodpercre összeomlik, ami a gyakorlatban a játékot „nem játszhatóvá” teszi..

Problémamegoldás

A közelmúltig a monitor és a számítógép (videokártya) közötti szinkronizálási problémákra a hagyományos válasz a V-Sync volt. Más szavakkal: függőleges szinkronizálás. Ez egy durva, de viszonylag hatékony módszer, amely a gyakorlatban a játék motorját szinkronizálja a képernyő frissítési gyakoriságával..

Sajnos, ennek a megoldásnak van egy komoly hátránya: csak akkor működik helyesen, ha minden következő képkocka másodpercenként kevesebb mint 1/60. Ha a keret előkészítése hosszabb ideig tart, akkor a kijelző frissítésének következő ciklusában egyszerűen nem lesz kész a megjelenítésre. Ennek megfelelően a videokártyának újra meg kell jelenítenie. Sajnos ez történik a legtöbb modern grafikus kártyával - még a legmagasabb osztályúakkal is -, és ennek látható eredménye bosszantó késedelem és egyéb kellemetlen mellékhatások.

Az NVIDIA itt beavatkozik az úgynevezett "adaptív szinkronizálás" gondolatába, amely esetükben G-Sync néven vált ismertté. Ez ellentétes a V-Sync-rel, amely arra kényszeríti a monitort, hogy szinkronizáljon a játékkal, és nem fordítva. Így még akkor sem, ha a hardver (videokártya) képes másodpercenként 30 képkockát szolgáltatni, ez nem lesz különösebb probléma, mert a rendszer megjelenése szinkronizálva lesz vele, és 30 Hz frissítési frekvenciával fog működni..

Ez a technológia az összes égboltból mannává válhat minden játékos számára, különösen azok számára, akik olyan laptopokkal játszanak, amelyek hagyományosan kevesebb játékteljesítményt nyújtanak, mint az asztali PC-k..

Nem csak a profik

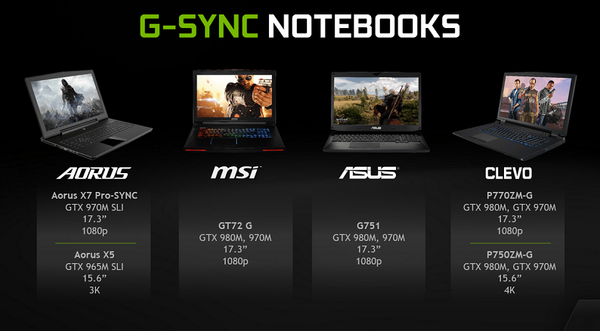

Papíron a G-Sync csodálatosan hangzik, és kiváló minőségű játékokat kínál még gyenge laptopokon is, amelyek egyébként csak álmodozhatnának az áhított 60 képkocka / másodpercről. A gyakorlatban azonban minden nem annyira egyszerű - különösen a G-Sync mobiltelefonokon történő megvalósítása tekintetében.

A probléma az, hogy az adaptív szinkronizálás végrehajtásához a számítógép-monitornak kiegészítő modulra van szüksége, amely dinamikusan beállítja a frissítési gyakoriságot a másodpercenkénti keretek számának megfelelően. Ez a modul drága, és ami még rosszabb, sok energiát igényel, ami nem megfelelő kiegészítést jelent, legalább laptopok esetében, amelyek esetében az energiafogyasztással kapcsolatos kérdések különösen fájdalmasak.

Ez a helyzet a G-Sync esetében 2013-ban, amikor az NVIDIA először jelentette be ezt a technológiát. Ennek ellenére a vállalat továbbra is aktívan dolgozott az adaptív szinkronizálás koncepciójának fejlesztésén, és ennek eredményeként a Mobile G-Sync, egyfajta eredeti ötlet, amelyet kifejezetten hordozható számítógépekhez fejlesztettek ki, nemrégiben mutatták be a világnak..

Mobil g-sync

Az új technológiai módosítás fő előnye, hogy nincs szükség külön hardver szinkronizáló modulra. Ehelyett a Mobile G-Sync az egyik legmodernebb interfész - a beágyazott DisplayPort (eDP) - képességeit használja, amely a legtöbb új generációs laptopmal rendelkezik..

A mobil verzióban a G-Sync szoftvert kínál, nem pedig hardveres adaptív szinkronizálási módszert. Komplex matematikai algoritmuson alapul, amely megpróbálja nagy pontossággal megjósolni a videokártya azon képességét, hogy elkészítse a következő megjelenítésre szánt keretet, és ezt figyelembe véve módosítja a képernyő frissítési gyakoriságát.

Természetesen a 100% -os pontosság elérése ebben az esetben lehetetlen, de még egy hozzávetőleges eredmény is komolyan tükrözi a játékélmény minőségét..

A Mobile G-Sync előnyei nyilvánvalóak: simább lejátszás, még gyenge hardverkonfiguráció esetén is, az energiafogyasztás növelése nélkül. De sajnos a technológiának vannak gyengeségei. Mint már említettük, a kép predikciójában nem lehet abszolút pontosságot elérni. Ezért az algoritmus részben feláldozza a szín pontosságát a rögzített frissítési gyakoriság és a simább lejátszás miatt.

A technológia gyakorlati megvalósításának kellemetlenebb mellékhatása az, hogy a Mobile G-Sync és az NVIDIA Optimus kölcsönösen kizárják egymást. Mint talán tudod, ez utóbbi népszerű szolgáltatás, amely lehetővé teszi a dinamikus váltást a központi processzorban található integrált grafikus mag és a különálló (GeForce) videokártya között. Tehát, ha könnyű feladatokkal, például az internet böngészésével és a dokumentumok szerkesztésével foglalkozik, a laptop integrált videót használhat, amely lényegesen kevesebb energiát fogyaszt, mint egy különálló grafikus adapter.

Ahhoz azonban, hogy a Mobile G-Sync működjön, a laptop képernyőjét közvetlenül egy különálló grafikus kártyához kell csatlakoztatni (természetesen az NVIDIA márkával). Ez a gyakorlatban kizárja az integrált grafikus mag részvételét a processzorban, és a Mobile G-Sync és az Optimus kölcsönösen kizárja egymást..

Az NVIDIA szerint ez nem jelent jelentős problémát, különösen a laptopok számára, amelyek új generációs GPU-val rendelkeznek - a Maxwell, amelyek rendkívül energiahatékonyak. Ez azonban egy fontos kompromisszum, amelyet sok OEM-partnernek meg kell tennie, ha úgy dönt, hogy opcióként kínálja a Mobile G-Sync-et a következő generációs játék laptopjain..

Természetesen független tesztek hiányában még mindig nem túl egyértelmű, hogy mekkora lesz ez a kompromisszum, és milyen mértékben befolyásolja a Mobile G-Sync használata az Optimus miatt az akkumulátor élettartamát.

Egy másik kérdés az, hogy még a legfejlettebb laptop modellek sem tudnak biztosítani különösen lenyűgöző autonómiát - különösen az olyan ultrahatékony mobil rendszerek, mint például a legújabb generációs ultrabooks körülmények között.

De figyelembe véve azt a tényt, hogy nagyon fejlett speciális hordozható konfigurációkról beszélünk, amelyeket egy olyan közönség (játékosok) számára terveztek, akik kedvelik a csúcsteljesítményt, az ilyen akkumulátor-élettartam-feláldozás alig végzetes lehet, ha a Mobile G-Sync teljesítse az ígéretét, hogy valóban jelentősen javítsa a játékélmény minőségét.

Remek napot!